OpenAI空前崛起之际,谷歌毅然打响了绝地反击战。

北京时间12月7日凌晨,谷歌CEO桑达尔・皮查伊和Deepmind CEO戴密斯·哈萨比斯在谷歌官网联名发文,官宣了最新多模态大模型Gemini 1.0(双子星)版本正式上线。这个上线时间早于外界猜测的明年1月,保密程度很高,仅有少数媒体提前猜出。

Gemini 1.0是谷歌筹备了一年之久的GPT4真正竞品,也是目前谷歌能拿出手的功能最为强悍、适配最为灵活的大模型,包括三种不同套件,分别是Gemini Ultra, Gemini Pro和Gemini Nano。其中Ultra的能力最强,复杂度最高,能够处理最为困难的多模态任务;Pro能力稍弱,是一个可扩展至多任务的模型;Nano则是一款可以在手机端侧运行的模型。这说明,Gemini的触达范围很广,可以下探至数据中心,也可以上行至移动设备端侧。

谷歌的Bard聊天机器人,此番也已经升级到了Gemini,可以说Gemini的初始版本已于今日开始在Bard中提供。从5月的I/O大会之后,谷歌就将自己此前最强的人工智能模型PaLm 2融入了Gemini的能力之中。

在一段公布的演示视频中,桑达尔・皮查伊展示了Gemini对视频、图像的非同凡响的识别能力。在视频中,Gemini极为自如地在图像、音频、视频各模态之间的转换,展现了惊人的解锁应用场景与产品形态的潜力。

谷歌自己也提到,到目前为止,创建多模态模型的标准方法基本是针对不同模态训练单独的组件,然后将它们拼接以粗略模仿其中一些功能。这会导致这些模型有时擅长执行某些任务,例如描述图像,但难以处理更概念性和复杂的推理。

其通过60页的相关技术报告证明,Gemini是一个真正原生的多模态大模型,因为从最初的预训练数据开始,Gemini就在针对不同模态的模型进行训练,因此其功能在每个重大领域都达到了SOTA(State of the art,特指领先水平的大模型)。

推荐一只相关个股

002354天娱数科

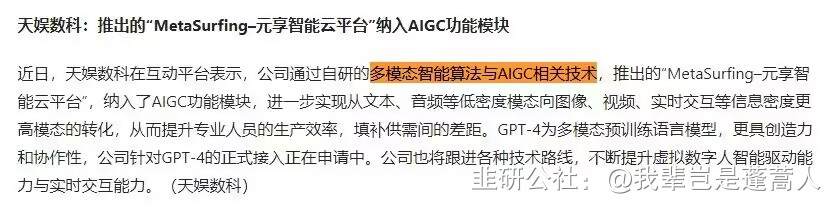

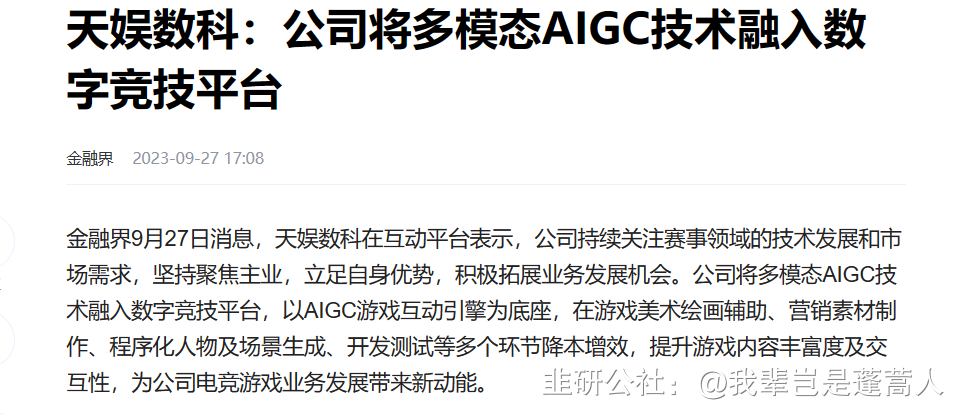

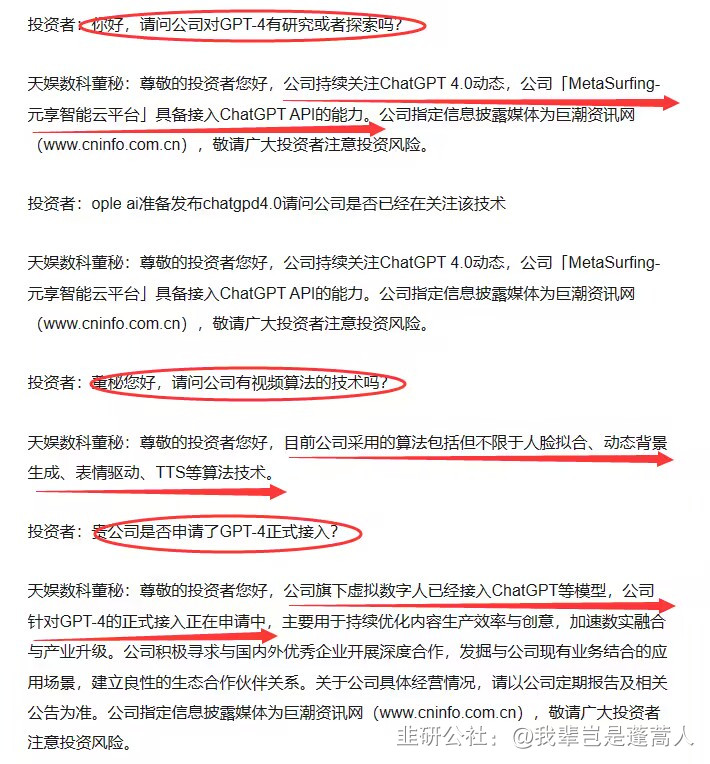

公司通过自研的多模态智能算法与AIGC相关技术,推出的“MetaSurfing-元享智能云平台”,纳入了AIGC功能模块,进一步实现从文本、音频等低密度模态向图像、视频、实时交互等信息密度更高模态的转化,从而提升专业人员的生产效率,填补供需间的差距。

- 1

- 2